随机变量与条件概率

条件概率

条件概率

当某事件已经发生时,一些随机事件的概率会因为已知信息的增加发生变化。

若已知事件 A 发生,在此条件下事件 B 发生的概率称为 条件概率,记作 P(B|A)。

在样本空间中,若事件 A 满足 P(A) > 0,则条件概率 P(\cdot|A) 定义为:

P(B|A) = \frac{P(AB)}{P(A)}

条件概率有时候也称为后验概率,与先验概率相对。

P(\Omega|A)=1.

若 B,C 互斥(BC=\varnothing)则:

P(B\cup C)=P(B)+P(C)

P(B\cup C|A)=P(B|A)+P(C|A)

P(\bar B|A)=1-P(B|A)

条件概率的计算有还有三个公式,我们详细讲解。

概率乘法公式

若 P(A) > 0,则对任意事件 B 都有

P(AB) = P(A)P(B|A)

注意到这也就是条件概率的定义式。

全概率公式

全概率公式指出,对于 A,B 两组对立事件,

P(B)=P(A)P(B|A)+P(\bar A)P(B|\bar A)

可以理解为,A 发生后 B 发生,和 A 不发生但是 B 发生概率之和。

In general,若一组事件 A_1, \cdots, A_n 构成 \Omega 的一个划分(两两不交且和为 \Omega,且对每个 i 有 P(A_i)>0),则对任意事件 B 都有:

P(B) = \sum_{i=1}^{n} P(A_i)P(B|A_i)

Bayes 公式

贝叶斯定理(也成贝氏定理)指出,若 P(A),P(B)>0,则:

P(A|B)=\dfrac{P(AB)}{P(B)}=\dfrac{P(A)P(B|A)}{P(B)}

可以理解为将中间的 P(AB) 用概率乘法公式展开,向左向右写出。

也可以将 P(A) 提出来,剩余的部分 P(B|A)/P(B) 称为标准似然度。

带入全概率公式,于是有:

P(A|B)=\dfrac{P(A)P(B|A)}{P(A)P(B|A)+P(\bar A)P(B|\bar A)}

一般来说,设可能导致事件 B 发生的原因为 A_1, A_2, \cdots, A_n(同样构成了互斥),则在 P(A_i) 和 P(B|A_i) 已知时可以通过全概率公式计算事件 B 发生的概率。但在很多情况下,我们需要根据「事件 B 发生」这一结果反推其各个原因事件的发生概率。

P(A_i|B) = \frac{P(A_iB)}{P(B)} = \frac{P(A_i)P(B|A_i)}{\sum_{j=1}^{n} P(A_j)P(B|A_j)}

随机变量的概念

随机变量是用来表示随机试验结果的变量,通常用大写字母 X,Y,Z 或小写希腊字母 \xi,\eta,\zeta 表示。

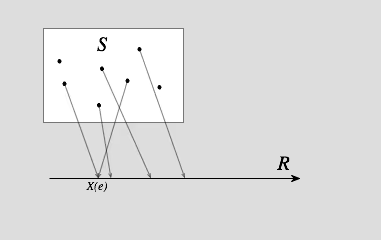

随机函数是一个特殊的实函数,对于任意 e\in S,都有唯一一个对应 X(e),如图。

随机变量实质上是样本空间上的函数,可作为因变量,满足其值不大于某数的状况都是事件。我们称随机变量这个函数的值域为随机变量的取值范围,或值域。

随机变量在不同的条件下由于偶然因素影响,其可能取各种随机变量不同的值,具有不确定性和随机性,但这些取值落在某个范围的概率是一定的,此种变量称为随机变量。随机变量可以是离散型的,也可以是连续型的。如分析测试中的测定值就是一个以概率取值的随机变量,被测定量的取值可能在某一范围内随机变化,具体取什么值在测定之前是无法确定的,但测定的结果是确定的,多次重复测定所得到的测定值具有统计规律性。随机变量与模糊变量的不确定性的本质差别在于,后者的测定结果仍具有不确定性,即模糊性。

随机变量按其值域(根据定义,随机变量是一个函数)是否可数分为离散型和连续型两种。

指示随机变量

在数学中,示性函数(Indicator Function)和指示随机变量(Indicator Random Variable)是两个密切相关但层次不同的概念:

示性函数(确定性函数):对于一个固定的集合 A \subseteq \Omega,示性函数 \mathbb{1}_A(\omega) 是一个普通函数,对每个 \omega \in \Omega,它输出确定的 0 或 1。它不涉及概率,只是集合的特征标签。

指示随机变量(随机变量):当样本空间 \Omega 上定义了概率测度 P 后,示性函数 \mathbb{1}_A 就成为一个随机变量——因为 \omega 是随机试验的结果,\mathbb{1}_A(\omega) 的值也随之随机。此时它的期望 E[\mathbb{1}_A] = P(A) 才有意义。

简单说:示性函数是“静态的集合特征函数”;指示随机变量是“动态的随机指示器”。在概率论语境下,两者常混用,但严格来说,“随机变量”这一名称强调了其所在的概率空间结构。

指示随机变量 I_A(也记作 \mathbb{1}_A)是一个只取 0 或 1 的二元变量,它像一个“探测器”,只报告事件 A 是否发生:

I_A(\omega)= \begin{cases} 1, & \omega \in A \quad \text{(事件发生)} \\ 0, & \omega \notin A \quad \text{(事件未发生)} \end{cases}

命名含义:Indicator(指示器)——指示事件 A 的真/假状态,将逻辑命题转化为数值信号。指示变量最强大的特性是其期望与事件概率的直接等价:

E[I_A] = 1 \cdot P(A) + 0 \cdot P(A^c) = P(A)

认知跃迁:这个公式建立了一座桥梁——将求概率转化为求期望,反之亦然。它是理解指示变量法的基石。

方差(补充性质):由于 I_A^2 = I_A,方差为

\text{Var}(I_A) = E[I_A^2] - (E[I_A])^2 = P(A) - P(A)^2 = P(A)(1-P(A))

这正是 Bernoulli 分布的方差公式。

方法本质:将一个复杂的随机变量 X 分解为多个指示变量之和,然后利用期望的线性性质求和。

标准算法(三步法):

分解:将 X 写成 n 个指示变量的和

X = I_1 + I_2 + \dots + I_n

其中 I_i = 1 表示第 i 个“子事件”发生。

线性化:利用 E[X+Y] = E[X] + E[Y](永远成立,无需独立性)

E[X] = E[I_1] + E[I_2] + \dots + E[I_n]

概率化:将每个 E[I_i] 替换为 P(A_i)

E[X] = P(A_1) + P(A_2) + \dots + P(A_n)

⚠️ 最震撼的洞察:期望的线性性质不要求变量独立。即使 I_1, I_2, \dots, I_n 之间存在复杂的依赖关系,只要你能分别求出每个 P(A_i),就能直接相加得到总期望。

帽子匹配问题(Derangement Problem):n 个人随机交换帽子,求恰好拿回自己帽子的人数的期望 E[X]。**暴力法(分布列路径)**需要计算 P(X=k) = \dfrac{\binom{n}{k} D_{n-k}}{n!}(D_m 为 m 个元素的错排数),然后求和 E[X] = \sum_{k=0}^n k \cdot P(X=k)。错排数的计算复杂,组合爆炸。

- 分解:设 I_i = \begin{cases}1, & \text{第 } i \text{ 人拿回自己帽子} \\ 0, & \text{否则}\end{cases},则 X = I_1 + I_2 + \dots + I_n。

- 线性化:E[X] = E[I_1] + \dots + E[I_n]。

- 概率化:对于任意 i,P(I_i=1) = \dfrac{1}{n}(第 i 人的帽子随机分给 n 个人中的一位)。

- 求和:E[X] = n \cdot \dfrac{1}{n} = \mathbf{1}。

结论:无论多少人,平均拿回自己帽子的人数永远是 1。仅用 4 行完成暴利法无法完成的计算。

羽毛球发球权问题(来自前一节):甲乙比赛,第一回合甲发球,每回合胜者发下一球。已知每人自己发球时胜率均为 2/3。求前 4 回合甲发球次数 X 的期望。**传统法(路径枚举)**枚举 2^3=8 种发球权转移路径,计算每种路径的概率,列出 X 的分布列,最后加权求和。过程繁琐,且 n 大时不可行。

- 分解:X = I_1 + I_2 + I_3 + I_4,其中 I_i = \begin{cases}1, & \text{第 } i \text{ 回合甲发球} \\ 0, & \text{否则}\end{cases}

- 线性化:E[X] = E[I_1] + E[I_2] + E[I_3] + E[I_4]

- 概率化:

- E[I_1] = P(S_1=\text{甲}) = 1(初始条件)

- E[I_2] = P(S_2=\text{甲}) = P(\text{甲赢第1局}) = \dfrac{2}{3}

- E[I_3] = P(S_3=\text{甲}) = P(S_2=\text{甲})\cdot\dfrac{2}{3} + P(S_2=\text{乙})\cdot\dfrac{1}{3} = \dfrac{5}{9}

- E[I_4] = P(S_4=\text{甲}) = \dfrac{14}{27}(递推计算)

- 求和:E[X] = 1 + \dfrac{2}{3} + \dfrac{5}{9} + \dfrac{14}{27} = \dfrac{74}{27}

优势:无需计算完整分布列,直接锁定期望,且极易推广至 n 回合(利用马尔可夫链递推)。

| 维度 | 传统分布列法 | 指示变量法 |

|---|---|---|

| 核心思想 | 整体 → 分类 → 汇总(枚举) | 局部 → 叠加 → 整体(分解) |

| 关键操作 | 计算所有互斥情况的概率 | 定义 n 个恰当的指示变量 I_i |

| 计算复杂度 | 指数级 \mathcal{O}(2^n)(组合爆炸) | 线性级 \mathcal{O}(n) |

| 独立性要求 | 通常需考虑依赖关系 | 完全不需要,线性性恒成立 |

| 输出结果 | 完整分布(所有 P(X=k)) | 仅期望 E[X] |

| 适用场景 | 需求方差、中位数、完整分布 | 仅需求平均、期望个数 |

何时使用指示变量法?

- 题目关键词:平均次数、期望个数、预计数量

- 随机变量天然可分解为多个二元状态之和(如:发生次数、命中数、成功次数)

- 直接求分布涉及复杂组合计数(如错排、配对、覆盖问题)

何时使用传统法?

- 需要知道 X 的完整分布(方差、分位数)

- 指示变量定义困难,或 P(A_i) 不易计算

传统分布列法依赖穷举与组合计数,本质是算力的比拼——你需要列出所有可能性并验证它们互斥且完备。

指示变量法依赖分解与线性叠加,本质是脑力的飞跃——你只需要回答一个简单问题:每个子事件发生的概率是多少? 无论这些子事件如何纠缠,期望的和永远等于和的期望。

💡 导师寄语:当你看到题目问平均、期望时,第一反应不应是怎么列分布表,而应是:我能否把这个总量拆成若干个 0-1 开关的和?

一旦你掌握了这种局部叠加思维,你就在概率认知上实现了从算力到脑力的质变。

离散型随机变量

如果随机变量 X 的取值是有限的或者是可数无穷尽的值:X(S)=\{x_1, x_2, \cdots, x_n\} 则称 X 为离散随机变量。

设 X 为离散型随机变量,其所有可能的取值为 x_1, x_2, \cdots,则我们可以用一系列形如 P\{ X = x_i \} = p_i 的等式来描述 X,这就是概率分布列。

| (X) | (x_1) | (x_2) | (\cdots) | (x_n) |

|---|---|---|---|---|

| (P) | (p_1) | (p_2) | (\cdots) | (p_n) |

连续型随机变量

如果 X 的取值遍布一区间甚至是整个数线 X(S)=[a,b] 则称 X 为连续随机变量。

设 X 为连续型随机变量,考察 P\{ X = x \} 往往是无意义的(因为这一概率很可能是 0)。

为什么说概率「很可能」是 0?考虑这样的随机变量 X:它以 1/2 的概率取 0,以 1/2 的概率服从开区间 (0, 1) 上的均匀分布。显然 X 满足连续型随机变量的定义。对任何实数 r \in (0, 1),不难得到 P\{ X = r \} = 0,但同时有 P\{ X = 0 \} = 1/2。

另一方面,设 X \sim F(x),则

P( l < x \leq l + \Delta x ) = F(l + \Delta x) - F(l)

一个自然的想法是用极限:

\lim\limits_{\Delta x \to 0^+} \frac{F(l + \Delta x) - F(l)}{\Delta x}

来描述 X 取值为 l 的可能性,这个式子就是我们熟知的导数,于是问题转化为寻找一个非负函数 f(x) 使得:

F(x) = \int_{-\infty}^{x} f(x) \text{d} x

若这样的 f(x) 存在,则称之为 X 的密度函数。

随机变量的独立性

前面讨论了随机事件的独立性。由于随机变量和随机事件紧密联系,我们还可以类似地给出随机变量独立性的定义。

定义:

若随机变量 X, Y 满足对任意的 x, y \in \mathbb{R} 都有

P( X \leq x, Y \leq y ) = P( X \leq x ) P( Y \leq y )

则称随机变量 X, Y 独立。

中学课本中对随机变量独立性的定义是用形如 P(X = \alpha) 的概率定义的,但由于连续性随机变量取特定值的概率通常是 0,故在更一般的情形下借助分布函数定义才是更加明智的选择。

性质

若随机变量 X,Y 相互独立,则对于任意函数 f, g,随机变量 f(X) 与 g(Y) 相互独立。

有时候我们会研究相互独立的随机变量 X,Y 的某一函数 f(X, Y)(如 XY^2)的分布。

尽管 X 与 Y 是独立的,但不能想当然地认为对 Y 的某一取值 y,f(X, y) 与 f(X, Y) 服从同样的分布。

根据 Qwen2.5-Max,这混淆了条件分布与无条件分布,错误认为独立性允许直接替换随机变量为常数而不改变分布。实际上,独立性仅保证边缘分布的分离,而非函数分布的等价性。

Markov 不等式

设 X 是一个取值非负的随机变量,则对任意正实数 a 有

P\{ X \geq a \} \leq \frac{EX}{a}

事实上,由于 Markov(马尔可夫)不等式本身并没有用到随机变量除期望外的与分布有关的任何信息,因此直接应用这个不等式得到的约束通常很松。

证明:

记 I 为事件 X \geq a 的示性函数,则有

I \leq \frac{X}{a}

这是根据下去整的性质,进而:

P\{ X \geq a \} = EI \leq \frac{EX}{a}

概率的应用

条件概率谬论

条件概率的谬论是假设 P(A|B) 大致等于 P(B|A)。

根据 Bayes 公式:

P(A)P(B|A)=P(B)P(A|B)

最经典的例子是患病概率,考虑到灵敏度、特异度等因素,本文不予讲解,详见 Wikipedia。

分布的深入理解

高中数学中的概率统计部分,特别是二项分布和超几何分布,确实被降维处理成了基于古典概型的组合数学应用题。这种处理方式虽然能够应付大多数考试题目,但存在一些认知盲区,如果完全忽略概率论的思维,只把它们当作排列组合的变体,可能会在以下几个方面遇到阻力或思维瓶颈。

二项分布的核心假设是独立重复试验(有放回抽样,或者总体无穷大)。每一次试验的概率 p 都不受上一次影响。

超几何分布的核心假设是不放回抽样(有限总体)。每一次抽取都会改变下一次抽取的条件概率。

在遇到复杂的应用题时,如果题目没有明确说明有放回还是无放回,只用组合思维容易陷入混乱:到底分母是 N^n 还是 C_N^n?关键在于判断独立性第二次发生这件事的概率,是否受第一次结果的影响?如果不受影响,就是二项分布;受影响,就是超几何分布。

二项分布描述的是进行 n 次相互独立、每次成功概率都等于 p 的伯努利试验,随机变量 X 表示成功次数。其概率质量函数为:

P(X=k)=\binom{n}{k}p^k(1-p)^{n-k}

其中 \binom{n}{k} 来自选出哪 k 次成功的计数;而 p^k(1-p)^{n-k} 来自概率乘法结构。每一种成功位置排列概率相同,共有 \binom{n}{k} 种。

超几何分布描述的是:总体大小 N,其中有 K 个成功类,不放回抽取 n 个,X 为抽到成功的个数。其概率质量函数为:

P(X=k)=\frac{\dbinom{K}{k}\dbinom{N-K}{n-k}}{\dbinom{N}{n}}

这几乎就是有利子集数与全部子集数之比,正是组合计数最擅长的。超几何分布强调不放回抽取会导致每次成功概率会发生变化。

高中课本推导二项分布期望 E(X)=np 时,通常是用 \sum k \cdot C_n^k p^k (1-p)^{n-k} 进行复杂的代数变形。这让学生觉得期望只是一个算出来的加权平均数。

其实在大学概率论中,可以使用指示变量法求解。令 X_i=\mathbf 1\{\text{第 }i\text{ 次成功}\},则 X=\sum_{i=1}^n X_i。由于期望具有线性性质,E[X]=\sum E[X_i]=np。若独立,方差 \mathrm{Var}(X)=\sum \mathrm{Var}(X_i)=np(1-p)。

对于超几何分布,哪怕是不放回抽样,期望的线性性质依然成立。因此超几何分布的期望公式形式上和二项分布非常像:

E[X]=n\frac{K}{N}

而方差为:

\mathrm{Var}(X)=n\frac{K}{N}\left(1-\frac{K}{N}\right)\frac{N-n}{N-1}

这里多出的 \frac{N-n}{N-1} 常被称作有限总体修正,直觉解释是不放回让抽样之间出现负相关,波动会更小。

当总数 N 很大时,超几何分布可以用二项分布近似。从信息的角度看,当总体有几亿条鱼时,捞走一条对整个池塘中鱼的比例影响微乎其微,此时不放回在数学上等价于有放回。在处理大样本抽样的题目时,可以使用二项分布进行近似以简化计算。

随机变量概念的重视:随机变量是一个函数,它把现实世界的结果映射到实数。如果把 X 仅仅看作是一个待求的未知数或符号,会影响后续学习。

重定义轻公式:做题前先判断是哪种分布,判据不是能不能用组合数,而是试验是否独立。

理解期望的线性:理解为什么 E(X)=np,不仅仅是因为公式推导,而是因为 X 是 n 个独立的伯努利试验的总和。

不要把概率当成数数:组合数只是计算离散型概率的工具,而不是概率的本质。概率的本质是对不确定性的度量。

当以后学到正态分布等连续型分布时,会非常痛苦。因为连续型分布不能用组合数数格子,概率不再是个数之比,而是面积(积分)。过于依赖组合数学的数数思维,一旦进入连续概率领域,思维模型就会崩塌。

生日悖论与密码学

利用生日悖论可以直观感受很多密码学的经典问题。

信息熵

信息熵描述了存储数据所占用的空间下限,若实际可用的空间低于这个下限则必然损失信息。

对随机变量 X,定义信息熵为:

H(X)=-\sum_{x}P(X=x)\log_2 P(X=x)

定义中对数底数为 2 是因为计算机中存储的信息每位只有 2 种取值:0 和 1。

例如设 X 服从 \{1,2,\dots,n\} 上的均匀分布,则其信息熵为:

H(X)=-\sum_{i=1}^n\frac{1}{n}\log_2\frac{1}{n}=\log_2 n

所以我们至少需要 \log_2 n 位来存储 1 到 n 的整数。